11

Convolución de dos

densidades de probabilidad

exponenciales Exp(?).

12

Suma de dos variables aleatorias

normales independientes

Dos densidades de probabilidad normales

tipificadas N(0,1).

13

Obtenemos la

densidad de

probabilidad de la

suma de las dos

variables por

convolución de sus

densidades.

Normalización

de N(0, v2)

El resultado es una normal de media 0 y varianza 2, N(0,2)

14

Suma de n variables aleatorias independientes

Teniendo en cuenta que:

Y que:

Tendremos para n variables aleatorias independientes:

Recuerda que la convolución es una operación conmutativa y asociativa.

15

Suma de n

uniformes

16

Suma de n

normales

17

Suma de n

exponenciales

18

Teorema central del límite

En condiciones muy generales la suma de n variables aleatorias , independientes e idénticamente distribuidas con media µ y varianza distinta de cero s2, tiende a la distribución normal a medida que n tiende a infinito.

Otra manera de enunciarlo: bajo las mismas condiciones, si n

es suficientemente grande

se distribuye como una normal N(µ, s2/n)

19

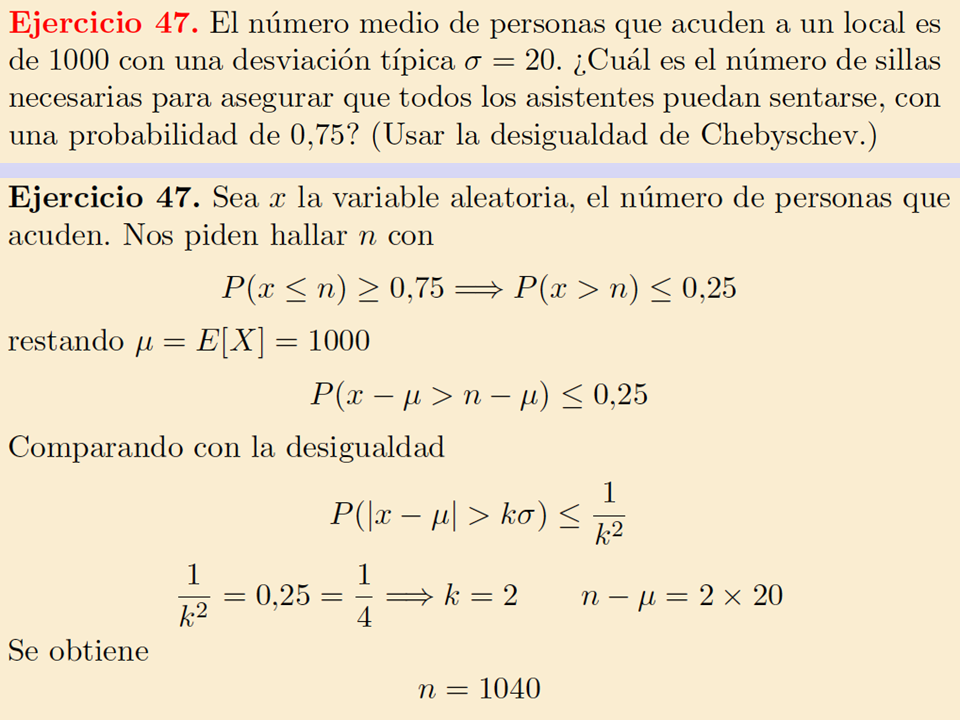

Desigualdad de Chebyshev (1821-1894)

Una varianza pequeña indica que las desviaciones grandes

alrededor de la media son improbables. La desigualdad de

Chebyshev hace precisa esta impresión:

O bien, haciendo:

Pafnuti Lvovic Cebicev

(1821-1894)

20

Demostración:

Para el caso discreto la demostración es semejante.

22

Ley de los grandes números (en forma débil)

Sean X1, X2, …, Xn variables aleatorias independientes, con la misma distribución (misma media µ y varianza s2). Entonces, para

Sn = X1 + X2 + … + Xn y cualquier real ? > 0:

«La frase "ley de los grandes números" es también usada ocasionalmente para referirse al principio de que la probabilidad de que cualquier evento posible (incluso uno improbable) ocurra al menos una vez en una serie, incrementa con el número de eventos en la serie. Por ejemplo, la probabilidad de que un individuo gane la lotería es bastante baja; sin embargo, la probabilidad de que alguien gane la lotería es bastante alta, suponiendo que suficientes personas comprasen boletos de lotería». Wikipedia

23

Demostración:

Usando la desigualdad

de Chebyshev y fijado

un épsilón:

24

Observa que Sn/n es un promedio y por eso a la ley de

los grandes números suele conocerse también como

ley de los promedios.

Hemos visto su "forma débil". En su "forma fuerte" nos

dice que si repetimos el lanzamiento de una moneda, la

proporción de caras se aproxima más y más a 1/2 a

medida que aumentamos el número de lanzamientos.

Si Sn es el número de caras en n lanzamientos, la ley

fuerte de los grandes números dice que cuando n tiende

a infinito:

25

En las gráficas se ha marcado con puntos

las probabilidades comprendidas entre

0.45 y 0.55.

Vemos como a medida que n crece la distribución se concentra más y más alrededor de 0.5 y el porcentaje de área correspondiente al intervalo (0.45, 0.55)

se hace más y más grande.

Distribuciones para el número de caras en n lanzamientos de una moneda.

La ley de los grandes números predice que el porcentaje de caras para n

grande estará próximo a 1/2.

26

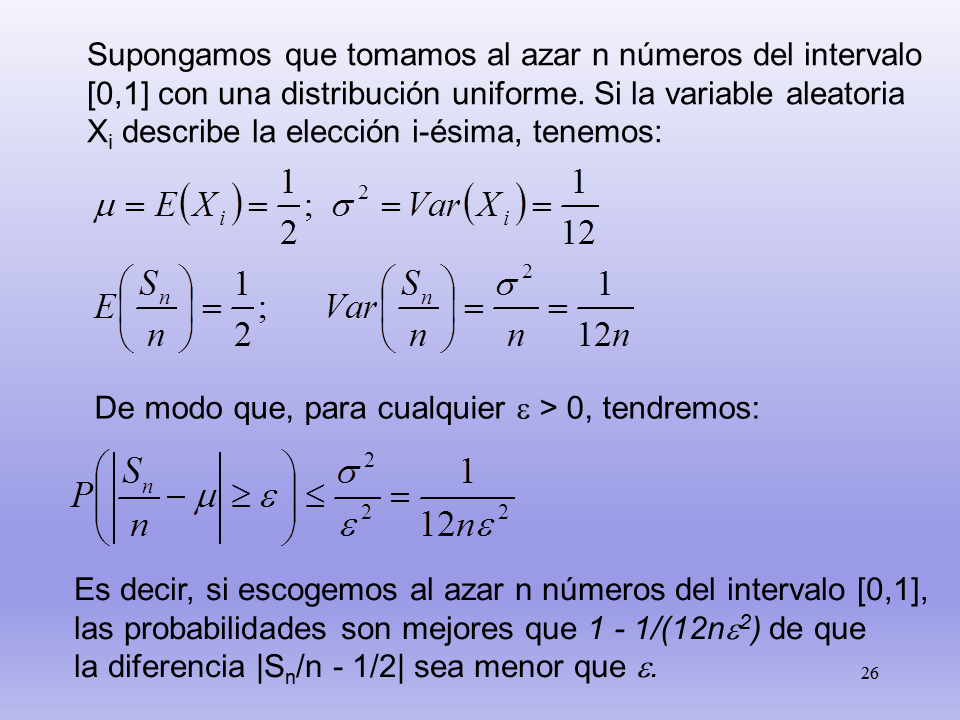

Supongamos que tomamos al azar n números del intervalo

[0,1] con una distribución uniforme. Si la variable aleatoria

Xi describe la elección i-ésima, tenemos:

De modo que, para cualquier ? > 0, tendremos:

Es decir, si escogemos al azar n números del intervalo [0,1],

las probabilidades son mejores que 1 – 1/(12n?2) de que

la diferencia |Sn/n – 1/2| sea menor que ?.

27

Gráficos semejantes al caso del lanzamiento de n monedas anterior, pero ahora con la suma de n valores independientes tomados de una U(0,1). Rigen los mismos comentarios.

28

Una aplicación al Método de Monte Carlo

Sea g(x) una función

continua definida en

el intervalo [0,1] y con

imagen en [0,1].

Vimos cómo estimar

el área bajo la función,

su integral, generando

pares de números (x,y)

al azar.

Existe una forma más

eficiente de calcular la

integral basándose en

la ley de los grandes números.

29

Escojamos una gran cantidad de números Xn al azar del

intervalo [0,1] con densidad uniforme. Definamos Yn = g (Xn).

El valor esperado de Yn es una estimación del área.

Como el dominio y la imagen de g(x) son el intervalo [0,1],

la media µ estará en [0,1] también y |g(x)- µ| = 1.

Que podemos leer como: la diferencia entre el área estimada

y la real, el error que cometemos, es mayor que épsilon con

probabilidad 1/n?2.

Página anterior Página anterior |   Volver al principio del trabajo Volver al principio del trabajo | Página siguiente  |